随着 5G 及车联网发展,物流业主需要更具智慧的管理物流驾驶的系统,现行市场中仍处于安装行车记录器来进行事后究责,无法达到事前预警及驾驶行为有效的改善。本提案透过两支摄影机(车前影像及驾驶画面)进行在线影像分析,使用高效AI运算主机(HPC)分析车前状况及驾驶行为,当发生异常事件后,进行即时告警,并进行事件录影,透过4G/5G网路提供管理者查阅,让管理者随时检视行车状态(例如跟车过近或行人追撞危险),即时发现并修正驾驶行为异常(例如分心)。

其用途为:

1. 保障驾驶安全

2. 透过驾驶行为智能分析来修正驾驶行为,以保护用路人安全

解决方案

本系统特别适合应用于 运输业 的驾驶管理,我们使用:

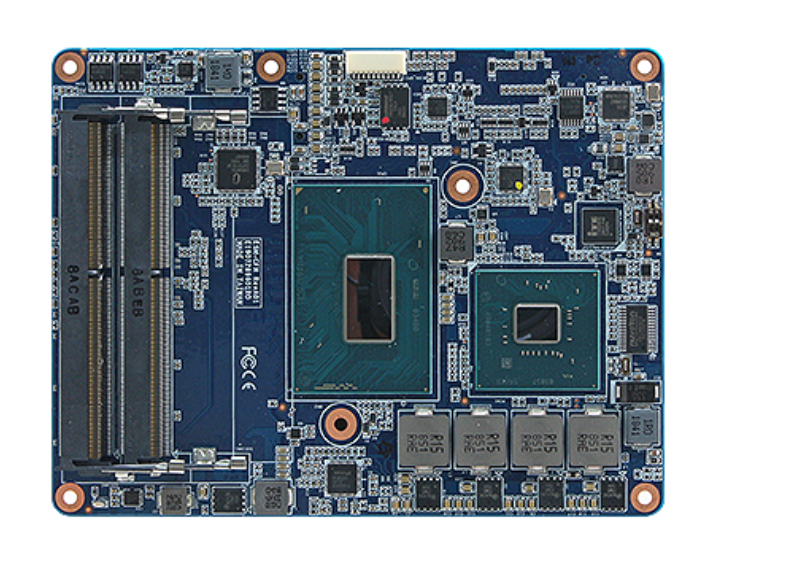

1. Intel 11 代 TigerLake Edge Computer 及 NCS2 神经棒来提供高效能的 AI 运算

2. 使用二支 Webcam 撷取车前及驾驶影像,其中车前影像进行人车物件侦测及追踪,称为 ADAS;车内影像进行驾驶人脸识别 [5]及头部姿态角追踪 [2],称为 DMS

3. 当系统侦测到 驾驶行为异常时,会即时提出警示,并进行后端录影

4. 车队管理者可以透过 4G/5G 路由连入检测驾驶行为 异常状况,可做驾驶行为评分依据。

在开发过程中所用软硬体如下:

硬体:

软体:

- 系统架构-开发硬体平台:Intel 11 代 TigerLake Edge Computer+ Intel® NCS2 + Webcam x2 + 路由器

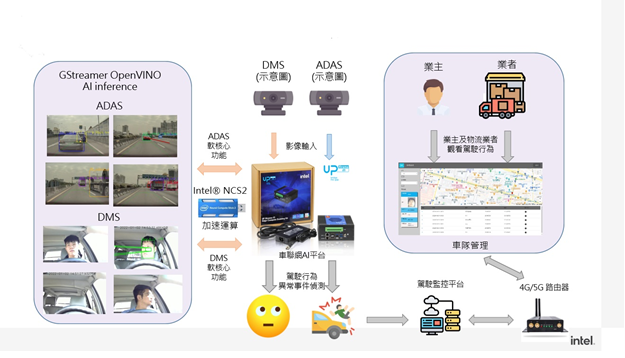

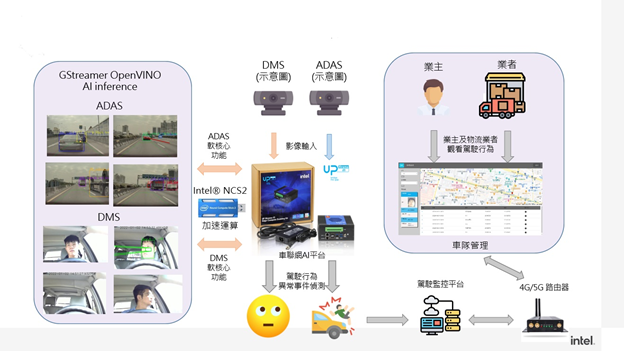

本系统由两支Webcam撷取车前及驾驶座影像,至车联网AI平台并将影像分流至OpenVINO平台进行AI inference,并将异常事件上传至驾驶监控平台,业主能透过驾驶监控平台得知目前驾驶状态。(图一所示)

图一 系统架构

- 技术架构-OpenVINO GStreamer [4]

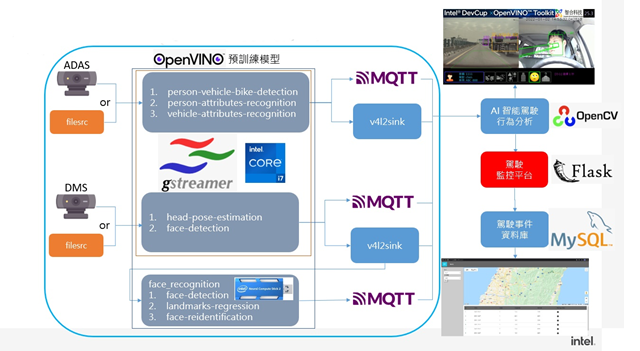

在串流处理,我们采用 OpenVINO 平台搭配 GStreamer 及 OpenCV 方式进行。

AI 顺向使用 OpenVINO 预训练模型 [1],主要有三类:

- 车前物件侦测及属性识别

- 人脸检测及头部姿态角追踪

- 人脸识别

影像输入,可透过 Web Camera 或 档案方式输入,Inference 后的影像输出到二路 V4L2 装置 [3]

使用 GStreamer 连接 ADAS 及 DMS 所需的预训练模型(由OpenVINO提供),将 Inference 后的结果,由 MQTT 传至团队开发的 AI 智能驾驶行为分析程式进行分析,使用 OpenCV 进行 online 贴图,并将驾使行为异常结果储存于资料库,管理者可透过 本团队开发之驾驶监控平台进行异常事件的检索。(图二所示)

图二 技术架构图

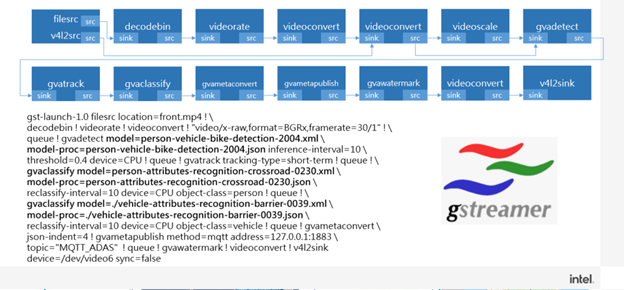

- ADAS Pipeline

图三为 GStreamer 连接 OpenVINO Model(人、车、自行车辨识)、(人物属性辨识)、(车辆属性辨识)之 ADAS Pipeline:

图三 ADAS Pipeline

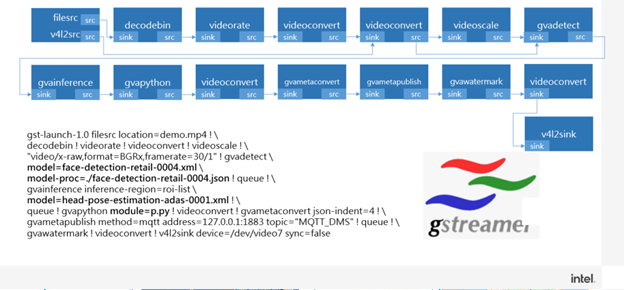

DMS Pipeline

图四为 GStreamer 连接 OpenVINO Model(头部姿态角辨识)、(人脸辨识)之DMS Pipeline:

图四 DMS Pipeline

成果介绍短片

成果介绍

- 安装模拟场景

图五 模拟场景

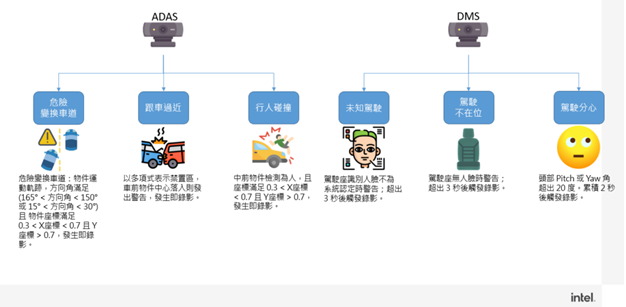

- ADAS 与 DMS 功能介绍及触发条件

图六 功能介绍

- 车机画面及驾驶监控平台 – 展示说明

图七 车机画面介绍

图八 驾驶监控平台操作步骤

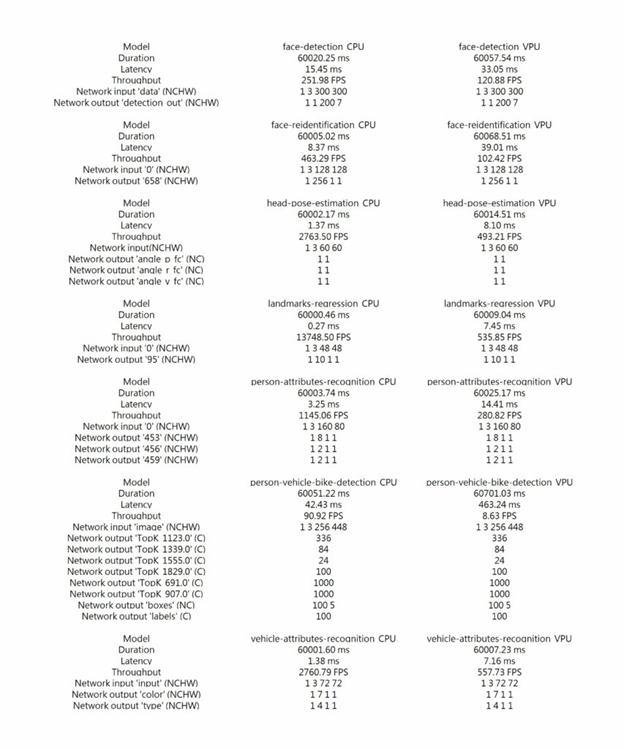

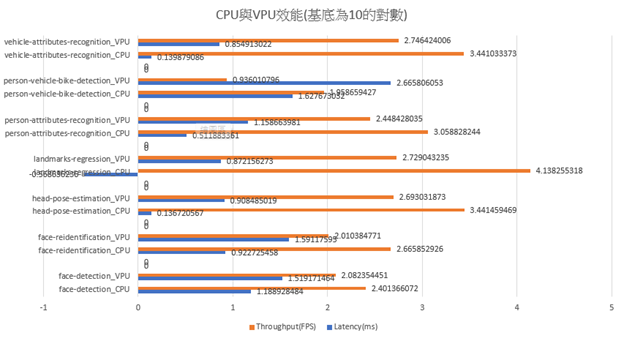

- 各项Model使用CPU及VPU效能表现

图九 Model使用CPU及VPU效能

图十 使用 CPU 及VPU 效能图表 (因值域差异大,以 Log10 对数表示)

图十一 装置工作详细内容

以下概略说明主要硬体的使用方式及整合后系统效能的表现,其中CPU 占比最高,功能包含:

1. 负责两项 AI 功能:车前物件侦测与追踪,及驾驶头部姿态角

2. 应用端的逻辑及 online OSD 贴图

3. 网页服务器及资料库

GPU 提供车机影像的显示,NCS2 神经棒负责第三个AI的功能:人脸侦测与识别。

输入资料量为两只 Web Camera 摄影机,其分辨率为 752×416@30 FPS,整合后的系统效能,张数大约落在 15~25 张。

本系统能即时分析辅助驾驶并让业主了解驾驶行为表现,可以进行员工教育,提升驾驶素质,保障驾驶及用路人的生命安全。

参考资料

- https://github.com/openvinotoolkit/open_model_zoo

- https://github.com/yinguobing/head-pose-estimation

- https://github.com/umlaeute/v4l2loopback

- https://github.com/openvinotoolkit/dlstreamer_gst

- https://github.com/bhatiaharshit07/Computer-Pointer-Controller

►场景应用图

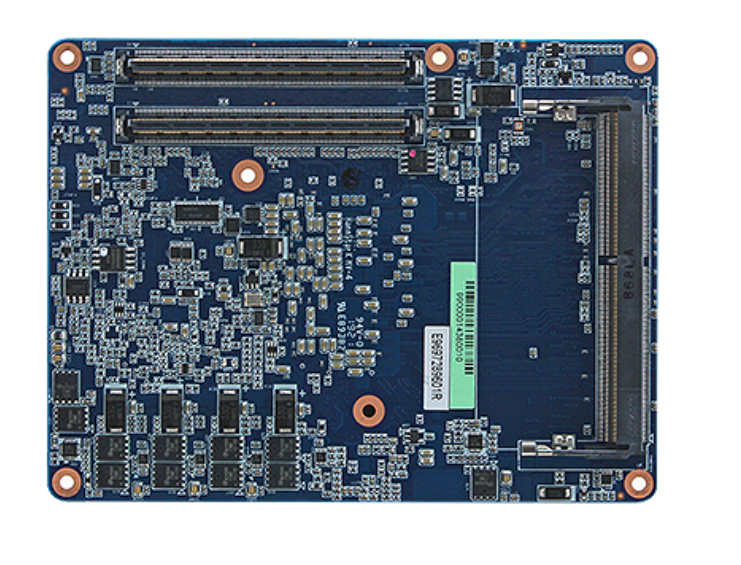

►产品实体图

►展示板照片

►方案方块图

►核心技术优势

1. 高效能 CPU 与 GPU 结合 AI 和深度学习功能,能够在各种用途整合工作负载,例如电脑数值控制 (CNC) 机器、即时控制、人机界面、工具应用、医疗成像与诊断(在超音波这类用途),以及需要具备 AI 功能高分辨率 HDR 输出的其他用途。 2. 显示芯片、媒体与显示器引擎可输出达 4x4k60 HDR 或 2x8K60 SDR,搭载两个 VDBOX,可以用 1080p 和每秒 30 个影格的方式,解码超过 40 个传入的视讯串流。引擎支援各种用途,例如数位招牌与智能零售(包括专为分析强化的 AI),以及具备推断功能的电脑视觉,适用于网路视讯录制器或机器视觉与检测这类用途。 3. 利用在 CPU 向量神经网路指令集 (VNNI) 执行的 Intel® DL Boost,或是利用在 GPU (Int8) 执行的 8 位元整数指令集,即可实现 AI 与推断加速。 4. 全新的物联网导向软硬体,实现了需要提供及时效能的各种应用。适用于可程式化逻辑控制器与机器人这类用途的快速周期时间与低延迟。

►方案规格

* 频率最高可达 4.4 GHz *搭载达 96 个 EU 的 Intel® Iris® Xe 显示芯片 *最高支援 4x4k60 HDR 或 2x8K60 SDR *Intel® Deep Learning Boost *最高 DDR4-3200 / LPDDR4x-4267 *Thunderbolt™ 4/USB4 与 PCIe* 4.0 (CPU) *Intel® Time Coordinated Computing(在精选的 SKU) *频内 ECC 与延伸温度(在精选的 SKU) *Intel® Functional Safety Essential Design Package (Intel® FSEDP)(在精选的 SKU)