这些摄像头都分布在哪里,一个智能汽车至少要多少个摄像头呢,主要功能是什么作用呢,这些摄像头的角度和像素要求都有什么不同?

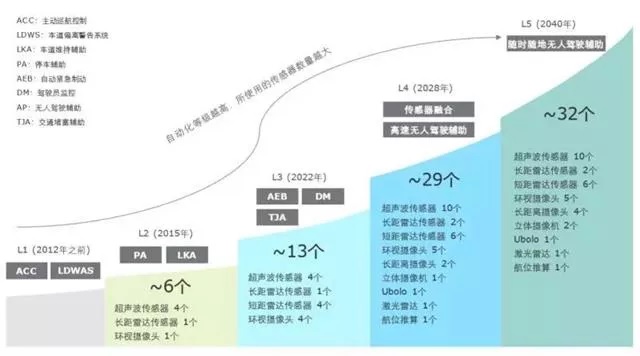

从主流车企代表车型的自动驾驶感知方案来看,都广泛采用了多种传感器融合的方案。以通用 Cruise AV 为例,通用目标是实现 L4 级别的自动驾驶,全车搭载 5 个 Velodyne 的 VLP16 16 线激光雷达、21 个毫米波雷达(其中有 12 个由日本 ALPS 提供的 79GHz 的毫米波雷达)以及16 个摄像头。

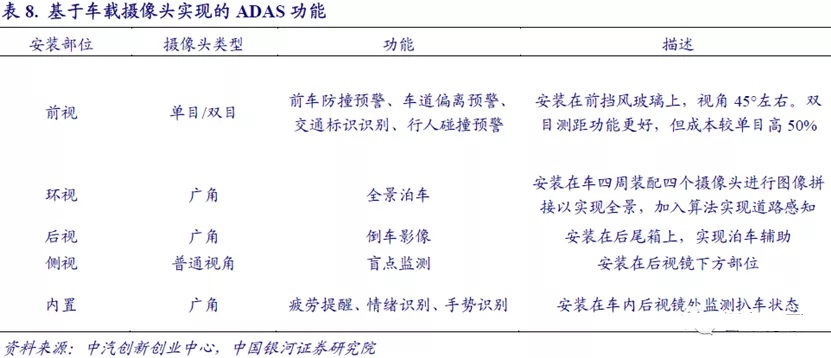

在 L3 以下级别自动驾驶中起着主导作用。根据 ADAS 不同的功能需要以及安装位置,车载摄像头包括前视、环视、后视、侧视以及内置摄像头,不同位置的摄像头功能各异,是实现自动驾驶必不可少的构成部分。

从上面的配置来看,智能汽车至少需要5个摄像头以上,一个前视+4个环视摄像头是最基本的配置,有的汽车厂家算法高级一些,把环视摄像头中的其中一个也同步作为后视的功能,这样最少就需要5个摄像头的配置。

前视摄像头:

由于前方探测过程采用了基本都是一致性的目标图像输出,通俗的讲,很多情况下都是无法变换图像大小的探测类型,这就导致当图像分辨率过低时,其探测距离不足,无法提前针对远距离小目标进行探测;而图像分辨率过高时,其探测的FOV不足,无法及时的对方便车道突然切入的目标进行反应。

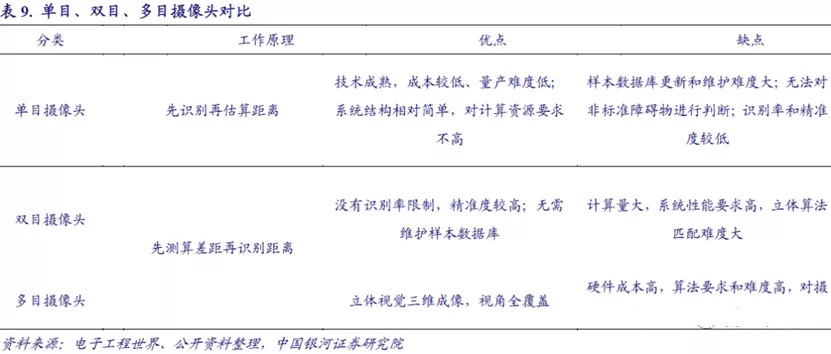

单双目镜头都是通过摄像头采集的图像数据获取距离信息,在前视摄像头的位置发挥重要作用;但二者的测距原理存在差别,单目视觉通过图像匹配后再根据目标大小计算距离,而双目视觉是通过对两个摄像头的两幅图像视差的计算来测距。

单目摄像头发展较早,目前技术发展已较为成熟,量产推广成本较低;但受限于单个摄像头定焦的局限,在不同距离下焦距切换难,难以兼顾测量的距离和范围。双目、多目摄像头在一定程度上克服了单个摄像头的局限,基于多个摄像头的配合能够获得更广的覆盖范围和更精准的数据。

但多个摄像头的硬件成本和以及相应的算法要求均较高,相应得配套设施发展尚不完善,现阶段很难量产并推广。单目摄像头由于芯片算力较低,成本较低,且与毫米波雷达、超声雷达搭配已能满足 L3 以下需求,因此短期内单目摄像头仍然是车载摄像头的主流方案。

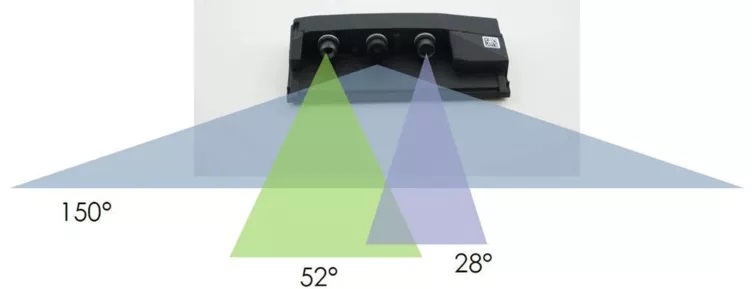

我们看看视觉为主的辅助驾驶的前视摄像头的设计,,前视摄像头直接就选择三目摄像头。

这个三目摄像头安装于挡风玻璃后,由3个组成:前视宽视野、主视野、窄视野摄像头。

宽视野:大角度鱼眼镜头能够拍摄到交通信号灯、行驶路径上的障碍物和距离较近的物体,非常适用于城市街道、低速缓行的交通场景。最大监测距离 60 米。

主视野:覆盖大部分交通场景,最大监测距离 150 米。

窄视野:能够清晰地拍摄到远距离物体,适用于高速行驶的交通场景。最大监测距离250米。

通过这个三目摄像头,钢铁直男把鱼和熊掌不可兼得的问题解决了,既有宽FOV角度的摄像头,像十字路路况比较复杂的路况就需要宽角度,高速路上需要有远距离的摄像头,一起解决了这个问题。

摄像头的图像分辨率和帧率也是需要重点考虑的。在解决了自动驾驶中央控制器的算力和带宽问题后,摄像头图像分辨率尽量越大越好,且考虑到车辆驾驶过程中需要具体解决的场景问题,一般是前向探测过程分辨率越大越好,当前主推的前视摄像头探测分辨率为800万像素。

前视摄像头是ADAS的核心摄像头,涵盖测距、物体识别、道路标线等,因此算法复杂,门槛较高,所以看一个汽车视觉算法是否牛掰,直接看能否有能力上多目前视摄像头。

环视摄像头

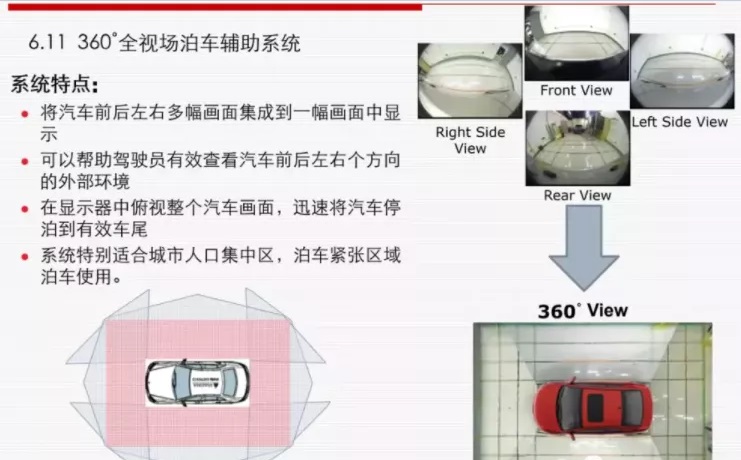

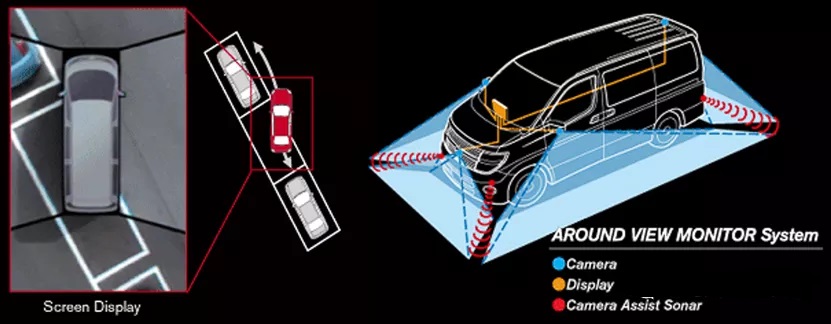

开过车的朋友都比较有痛点,特别是倒车的时候,需要眼观六路,耳听八方,哪怕是有倒车后视和倒车雷达,旁边两边的环境也是要随时关注的,所以最开始360全景图像的痛点是解决全方位可以看到图像来停车。

由于要拼接成一幅360°图像的画面,理论上3个摄像头也是可以完成拼接的,但是在车辆上的位置就不方便布置,基本上只能放置在车顶的位置了,同时软件算法拼接难度也增大,所以目前都是至少需要4个摄像头,而且是需要宽FOV广角摄像头。

安装位置:车辆前后车标(或附近)、以及集成于左右后视镜上的一组摄像头环视摄像头,作用在于识别出停车通道标识、道路情况和周围车辆状况,使用多个摄像头的图像进行拼接,为车辆提供360度成像,因为车声周边情况的探测需求,一般安装在车前方的车标或格栅等位置。

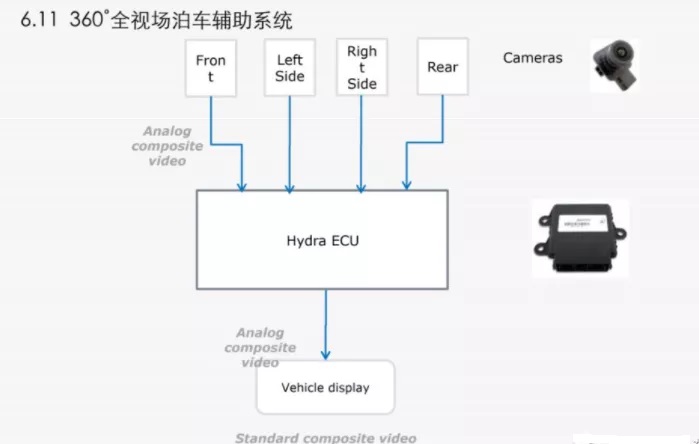

360环视的图像信息比较多,在很多车型都是有一个360图像处理器,在这个处理器中进行图像的拼接算法处理,把拼接好的图像在通过视频传输芯片,传输给到座舱控制器进行显示,这样对于座舱的主芯片的算力就降低了很多的要求,当然现在座舱域控制器的CPU芯片算力越来越强,处理这个360环视毫无压力,这样对于主机厂而言就可以节省一个360处理器,成本节省不少。

360摄像头的图像主要是给驾驶员使用的,这个图像的精度要求就没有那么高,而且观测的距离位置也比较近,所以图像的像素要求没有那么高,而且像素越高对于处理器的处理能力也更高,目前360环视摄像头都是100W-200W像素的摄像头就完完全全可以满足要求了。

侧视摄像头

侧方探测中,当前采用的毫米波雷达技术主要是应用在自动变道上,原理也很简单,主要是毫米波雷达依靠了车辆目标的反射点进行。这里我们需要澄清一点,侧角雷达对于车辆目标的探测通常只能保证其探测到相邻车道的车辆目标,而对于第三车道的车辆目标的探测几乎是束手无策的,这一过程对自动驾驶带来的潜在危险影响也是比较巨大的。比如当自车在从当前车道切入到第二车道,而第三车道同时有车切入第二车道时,如果本车道车辆无法对该切入车辆进行有效检测,其结果就是导致两车很可能相撞。

此外,侧方雷达无法实现对侧方车道线的有效探测,无法弥补由于前视摄像头探测局限所带来的盲区,也无法为侧向融合的Freespace提供支撑,所以智能汽车一般需要增加侧视摄像头。

侧视摄像头主要是用于盲点监测BSD,根据安装位置可以实现前视或后视作用。目前大部分主机厂会选择安装在汽车两侧的后视镜下方的位置,未来可能取代倒后镜。

侧方前视:90 度角侧方前视摄像头能够监测到高速公路上突然并入当前车道的车辆,在进入视野受限的交叉路口时也可提供更多的安全保障。

侧方后视摄像头:监测车辆两侧的后方盲区,在变道和汇入高速公路时起着重要作用。车身共配有 8 个摄像头,可以形成360°的视野,对周围环境的监测距离最远可达 250 米。8个摄像头可以分为3个前视、2个侧方前视、2个侧方后视以及1个后视摄像头。

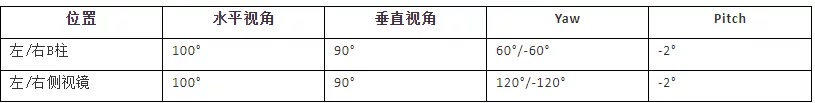

侧视摄像头性能要求

1、侧视摄像头探测的目标一般是侧方车道目标,侧方车道的场景匹配库中一般针对自动驾驶安全驾驶的场景较少,同时对于其侧方探测距离也比前方探测要求更近,因此侧方探测的分辨率要求可以稍比前视低一些,推荐一般采用200万像素的摄像头即可满足要求。当然如果不考虑成本和处理效率,也可以参照前视摄像头方案进行传感器搭载。

2、环视一般采用 135 度以上的广角镜头。

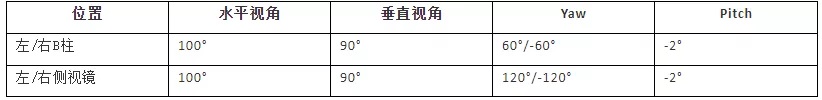

3、相机的安装位置和相机的配置很大程度上决定了视觉感知的范围和精度。基于对目前运行设计域(ODD)的理解,侧视相机配置除了必须达到车规标准的信噪比,低光照的性能以外,还需要满足以下参数要求:

4、此外,针对摄像头布置位置而言,主要关注的点包含防水防尘等级以及其探测范围内是否有可遮挡其探测的部分。而对于侧视摄像头来说,由于一般需要布置在车辆侧方位,一般可布置的位置是参照全景摄像头的布置位置,放在外后视镜下方,甚至专用翼子板附近。这就对摄像头本身硬件模组的大小、尺寸、重量等提出了新的要求。一个基本的典型相机安装方案草案,推荐的安装位置如下:

基于目前已知信息,以及相关开发中的一些经验,视角交叉可以保证以相对窄角的相机同时有效覆盖本车车身近距离和远距离。侧前和侧后的功能略有不同,侧前侧场景检测。安装位置和 Pitch 角度可偏高,FOV 略宽,侧后主要是检测远后、近后临近车道的车辆,用于高速入口并线、本车换线。Pitch 角度可偏低,yawn 角度更接近与本车中线平行,FOV 略窄。具体参数可能在设计过程中需要调整。

后视摄像头

后视摄像头主要是用于倒车过程中,便于驾驶员对车尾后面影像的捕捉,实现泊车辅助功能。安装位置:一般安装在尾箱或后挡风玻璃上

DMS 内置摄像头

由于现有自动驾驶仅仅位于L2-3级,还需要人类驾驶员干预。因此,驾驶员监控系统DMS成为一个解决方案出现在ADAS中。现有的DMS解决方案主要是采用近红外摄像头的AI识别来完成。这个摄像头在驾驶员前方,能够完整的拍到驾驶员面部信息。

安装位置:无固定位置,方向盘中、内后视镜上方、A柱或集成于仪表显示屏处均有。

车内摄像头的位置就是在内后视镜上方,这个位置是很多车厂都希望放到的一个位置,识别率更精准一些。

车规级摄像头设计要求及选型规格汇总

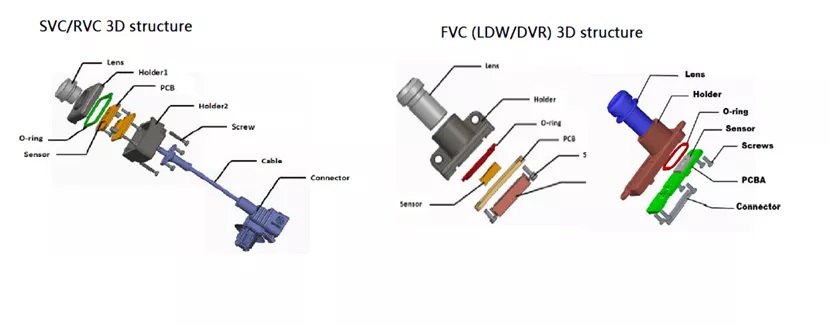

因此,ADAS的摄像头硬件模组爆炸图如下,相应的性能设计中主要考虑如下因素:图像传输方式、输出分辨率、帧频、信噪比、动态范围、曝光控制、增益控制、白平衡、最低照度、镜头材质、镜头光学畸变、模组景深、模组视场角、额定工作电流、工作温度、存储温度、防护等级、外形尺寸、重量、功能安全等级、接插件/线束阻抗等。

具体来看,为应对复杂多样的使用环境,车载摄像头需要具备高动态性,其温度范围一般为-40 度~80 度,同时需要具备较高的防磁抗震性能,此外还需满足 8-10 年的基本使用寿命要求。性能方面,考虑到芯片处理负担,车载摄像头的像素要求较低,一般为100万-200 万像素,功率一般也在 10W 以下。

车载摄像头环境条件更为严苛,也相应具有更高的价值量。相较于传统的工业摄像头和手机摄像头,车载摄像头需要在高低温、湿热、强微光和振动等各种复杂工况条件下保持稳定的工作状态,因此车载摄像头具有更高的安全等级要求和工艺性能要求。考虑到安全因素,汽车厂商倾向于选择技术成熟、品质有保障的零部件厂商,因此车载零部件厂商进入市场体系获得评级需要更长的认证周期,行业壁垒较高。

前视、环视、后视摄像头常见的结构造型

上图左边是SVC(环视),RVC(倒车后视)的摄像头架构,由于该摄像头是布局在车外,需要做很好的防水要求,同时需要长距离传输,需要视频对传芯片传输,通常采用同轴传输方式,主要是从成本方面考虑的,双绞线的成本太贵,车厂根本承担不了,7-8米的后拉摄像头的车规级双绞线线材的成本需要去到100RMB,所以可以看到车外的摄像头传输一般采用同轴线传输。

上图右边是FVC也即是前视摄像头,此类摄像头一般不用组装成完整的摄像头成品,一般都是使用在车内,只需要出货摄像头模组即可,防水要求等级也低,同时传输到CPU的距离也近,一般采用MIPI信号传输,通过FPC线材短距离传输就可以给到CPU那端,成本和性能都能有保障,非常低的成本方案。

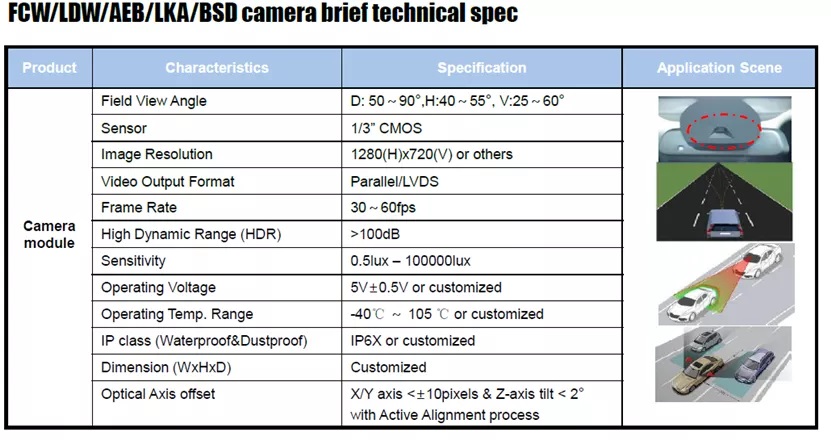

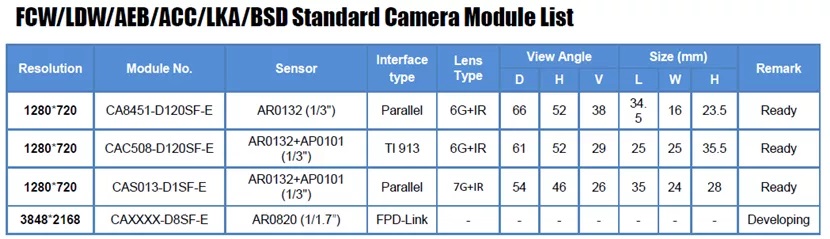

前视摄像头选型汇总:

可以看到前视的摄像头所需要的FOV角度都不大,一般都选择H方向在40-50°左右,频率为30-60HZ,需要高动态的的摄像头100db,像素一般在100W-200W之间,主流的还是在100W的摄像头。

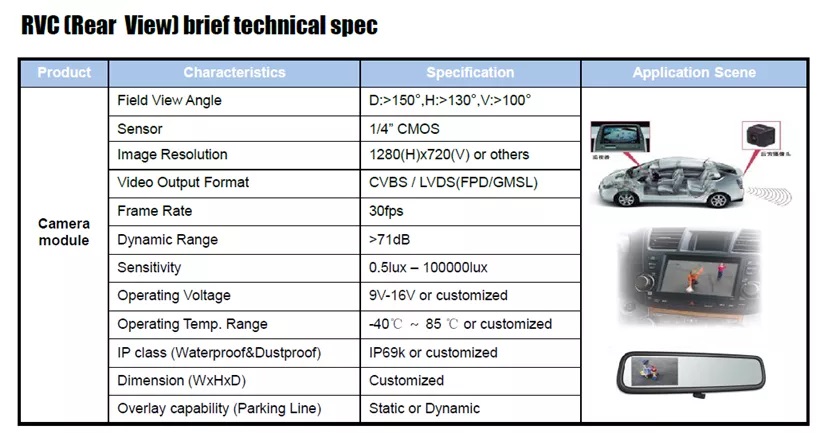

倒车摄像头选型汇总:

可以看到倒车后视由于需要看的距离并不远,重点关注的角度范围要款一些,方便倒车时的视线,所以FOV角度都达到H 大于130°,同时像素也需要大于100W像素,在显示屏上看到的图像才高清,这里的摄像头由于是做倒车后视使用,一般从成本角度出发,不使用宽动态的摄像头,只需要大于70db就行,摄像头的刷新率也只需要30HZ以上就行。

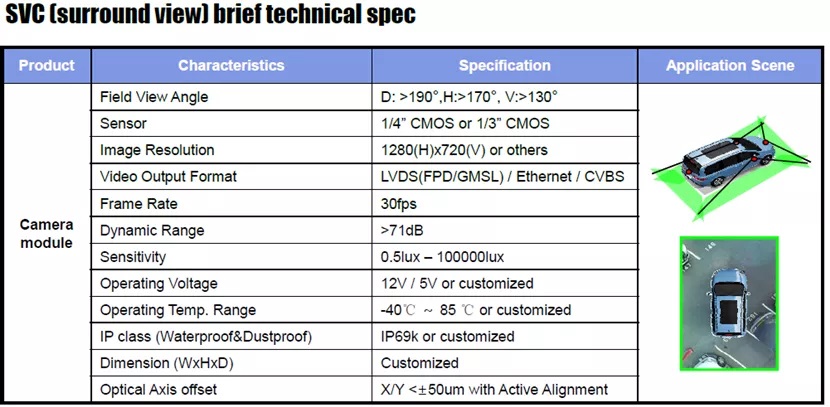

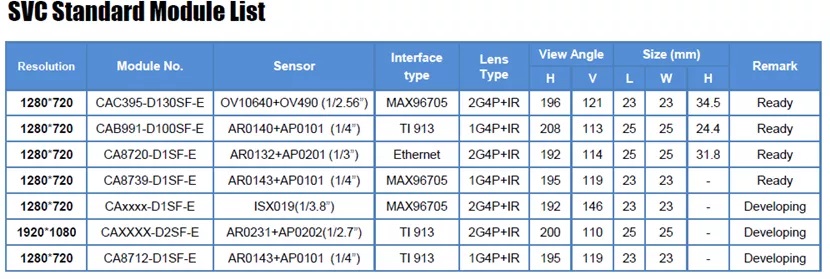

环视摄像头选型汇总:

可以看到环视摄像头的指标同前视指标非常相同,都需要宽动态,同时传输接口也是GSML传输协议为主,FOV可视角度非常大,因为要做图像拼接,所以这里的视角需要H大于170°,非常广角的摄像头要求,同时刷新频率需要大于30HZ以上。

车载摄像头系统架构简单阐述

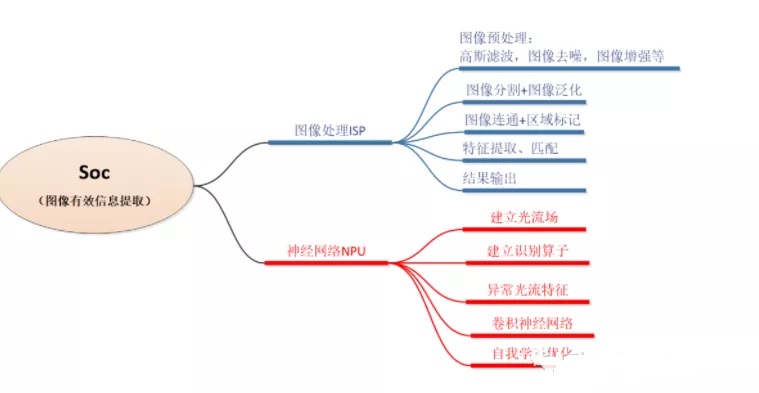

如下图表示了下一代自动驾驶系统方案基础架构。其关键要素中,图像处理Soc部分主要涵盖了对摄像头图像的传感输入图像处理ISP及目标融合,当然雷达或激光雷达也可以将原始数据作为输入信息进行目标输入。而逻辑控制单元MCU负责处理Soc的目标融合结果,并输入至运动规划及决策控制模型单元进行处理,其处理的结果用于生成车辆控制指令,控制车辆的横纵向运动。

对于图像处理软件模型而言,主要放在Soc芯片中进行。其中的软件模块主要包括图像信号处理ISP、神经网络单元NPU、中央处理器CPU、编解码单元CODEC、MIPI接口输出、逻辑运算MCU接口输出。

其中两个最耗费算力的计算单元包括图像信号处理ISP及神经网络单元优化NPU。

以上优化的结果一方面是生成图像基础信息结果,通过输入给中央处理单元CPU进行综合信息处理分配。一方面应用于编解码单元CODEC,进行解码后的图像通过MIPI接口输出至视频娱乐影音系统进行显示,同时进行环境语义解析后的结果输入至ADAS逻辑控制单元MCU,该模块可以通过与其他环境信息数据源(如毫米波雷达、激光雷达、全景摄像头、超声波雷达等)进行信息融合后生成环境融合数据,并最终用于车辆的功能应用控制。

当然如果考虑到智能行车辅助控制会有部分信息输入给其他智能控制单元进行信息融合,则需要将生成的结果通过以太网输入到网关,由网关进行转发后输入至其他单元,比如智能泊车系统、人机交互显示系统等。